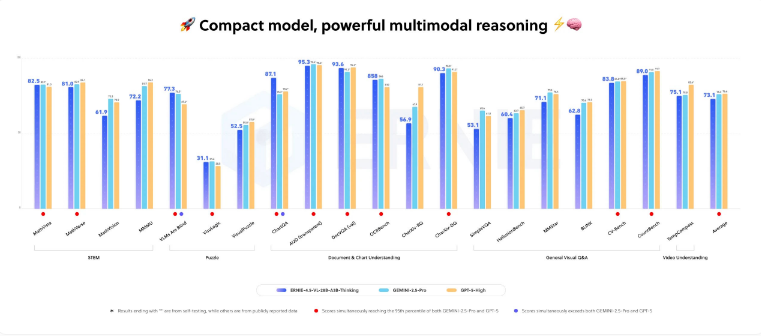

百度近日推出了其最新的多模态人工智能模型——ERNIE-4.5-VL-28B-A3B-Thinking,这是一款能够将图像深度整合到推理过程中的新型AI模型。百度声称,这款模型在多项多模态基准测试中表现出色,偶尔超越了包括谷歌的Gemini2.5Pro和OpenAI的GPT-5High在内的顶尖商业模型。

轻量级与高性能的结合

尽管该模型总参数量为280亿,但由于采用了路由架构,它仅使用了30亿个活跃参数进行推理。凭借这种高效的架构,ERNIE-4.5-VL-28B-A3B-Thinking 可以在单个配备80GB GPU(例如Nvidia A100)的设备上运行。百度已通过Apache2.0许可证发布该模型,允许其免费用于商业项目。不过,百度所宣称的性能尚未经过独立验证。

核心能力:“图像思维”与精确定位

该模型的突出特性在于其**“图像思维”(Image Thinking)**功能,使其能够在推理过程中动态处理图像,以突出关键细节。例如,该模型可以自动放大图像中的蓝色标志并准确识别出上面的文字,相当于在内部使用了图像编辑工具进行处理。

其他测试显示了其强大的多模态能力:

能够精确定位图像中的人物并返回其坐标。

通过分析电路图解决复杂的数学问题。

根据图表数据推荐最佳游览时间。

对于视频输入,能够提取字幕并将场景与特定时间戳匹配。

可以访问外部工具,例如基于网络的图像搜索,以识别陌生物体。

行业背景与功能对比

尽管百度强调了 ERNIE-4.5-VL-28B-A3B-Thinking 在推理过程中能够裁剪和处理图像,但这种方法并非全新。早在2025年4月,OpenAI就已在其o3和o4-mini模型中推出了类似功能,允许模型将图像直接整合到内部思维流程中,并在处理视觉任务时使用缩放、裁剪和旋转等原生工具,为类智能体的推理和问题解决能力树立了新的标杆。

.png)

(696x696).jpg)

发评论,每天都得现金奖励!超多礼品等你来拿

登录 在评论区留言并审核通过后,即可获得现金奖励,奖励规则可见: 查看奖励规则