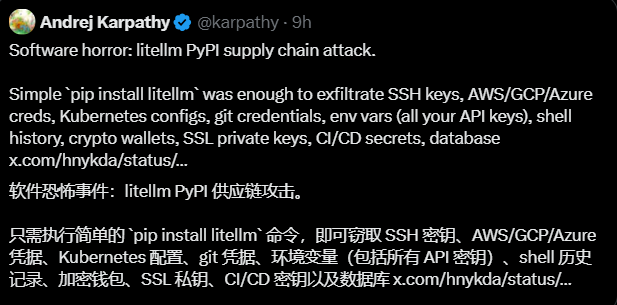

近日,在开发者群体中备受推崇的 AI 网关初创公司 LiteLLM 正式对外宣布,将彻底移除其平台中极具争议的辅助工具 Delve。此举旨在回应社区对数据隐私及模型透明度的强烈质疑,试图通过“断臂求生”来挽回核心用户的信任。

作为连接开发者与多种大模型的关键桥梁,LiteLLM 此前引入 Delve 原意是为了优化提示词分析与响应速度。然而,不少技术专家指出,Delve 在处理敏感数据时存在暗箱操作风险,其底层逻辑与主流开源精神背道而驰。

面对愈演愈烈的舆论压力,LiteLLM 创始人公开承认,在筛选合作伙伴时未能进行足够严谨的安全评估。为了维护平台中立性,团队决定迅速剔除所有关联代码,并承诺未来将转向更加透明、可审计的开源替代方案。

AIbase 视角认为,此次“割席”事件揭示了 AI 中间层架构在追求效率与保障安全之间的激烈冲突。对于依赖第三方网关的企业而言,上游供应商的每一次功能调整,都可能直接关乎其业务的合规命脉。

在当前 AI 生态圈中,单纯的“好用”已不足以支撑起一个平台的长远发展,底层逻辑的清白透明正成为新的准入门槛。LiteLLM 的果断止损虽短期内造成了功能波折,但从长远看,这是构建技术信任护城河的必然选择。

这场风波也给所有 AI 基础设施初创公司敲响了警钟:在算法黑盒层出不穷的今天,任何模糊地带都可能成为埋下品牌危机的导火索。只有坚持高度的工程透明度,才能在群雄逐鹿的 AI 接入层竞赛中站稳脚跟。

.png)

960x540.jpg)

发评论,每天都得现金奖励!超多礼品等你来拿

登录 在评论区留言并审核通过后,即可获得现金奖励,奖励规则可见: 查看奖励规则